A certificação NVIDIA GenAI vale a pena? Nossa análise honesta

Margot Fournier e eu (Matthieu De Cibeins) somos Cientistas de dados e consultores Em LittleBigCode. Passamos com sucesso pela NVIDIA GenAI Caminho de aprendizagem E Certificação em outubro de 2024. Este artigo tem como objetivo fornecer um feedback honesto sobre sua Pontos fortes e fracos, uma visão geral do plano de aprendizado e o máximo de detalhes possível sobre a melhor forma de prepará-lo.

Por que escolher a certificação NVIDIA GenAI?

Devido aos vários tipos de dados e suas especificidades, o escopo da ciência de dados é tão grande que é raro encontrar um cientista de dados que domine vários domínios de especialização dentro dela (Séries temporais, Visão computacional, Dados tabulares, Processamento de linguagem natural, e assim por diante). No entanto, dada a evolução extremamente rápida do ecossistema de IA — como descreve o burburinho atual da GenAI — continua relevante que um consultor de IA demonstre um nível mínimo em todos os campos, para poder entender os conceitos básicos de cada um deles. Esse é o conceito central do Matriz de competências “em forma de T” Caro para LittleBigCode.

Ilustração da forma de T

Dada a rápida evolução do Tecnologias GenAI, encontrar o caminho de aprendizado certo para aprimorar rapidamente suas habilidades em GenAI foi uma tarefa estratégica para a LittleBigCode e levou à escolha de dois consultores para avaliar a certificação GenAI da NVidia: um consultor sênior de ciência de dados, com forte experiência em séries temporais e forte experiência em séries temporais e dados tabulares, mas menos conhecimento em GenAI; e um consultor mais júnior, com experiência em Séries temporais E dados de satélite, mas também alguma experiência com modelos de PNL mais antigos, como o BERT.

Entre as certificações GenAI, escolher a da NVidia foi bastante simples. Na verdade, algumas empresas se arriscaram a criar caminhos de aprendizado e certificações em torno desse domínio em rápida mudança — os grandes, Google e Microsoft, podem estar esperando que a onda GenAI se acalme. A NVIDIA não. Essa apareceu como uma grande oportunidade para comparar as tecnologias desse gigante do hardware de IA — sem falar que eles também estão aumentando sua oferta de software, o que tornou essa formação ainda mais interessante.

Em que consiste a certificação NVIDIA GenAI?

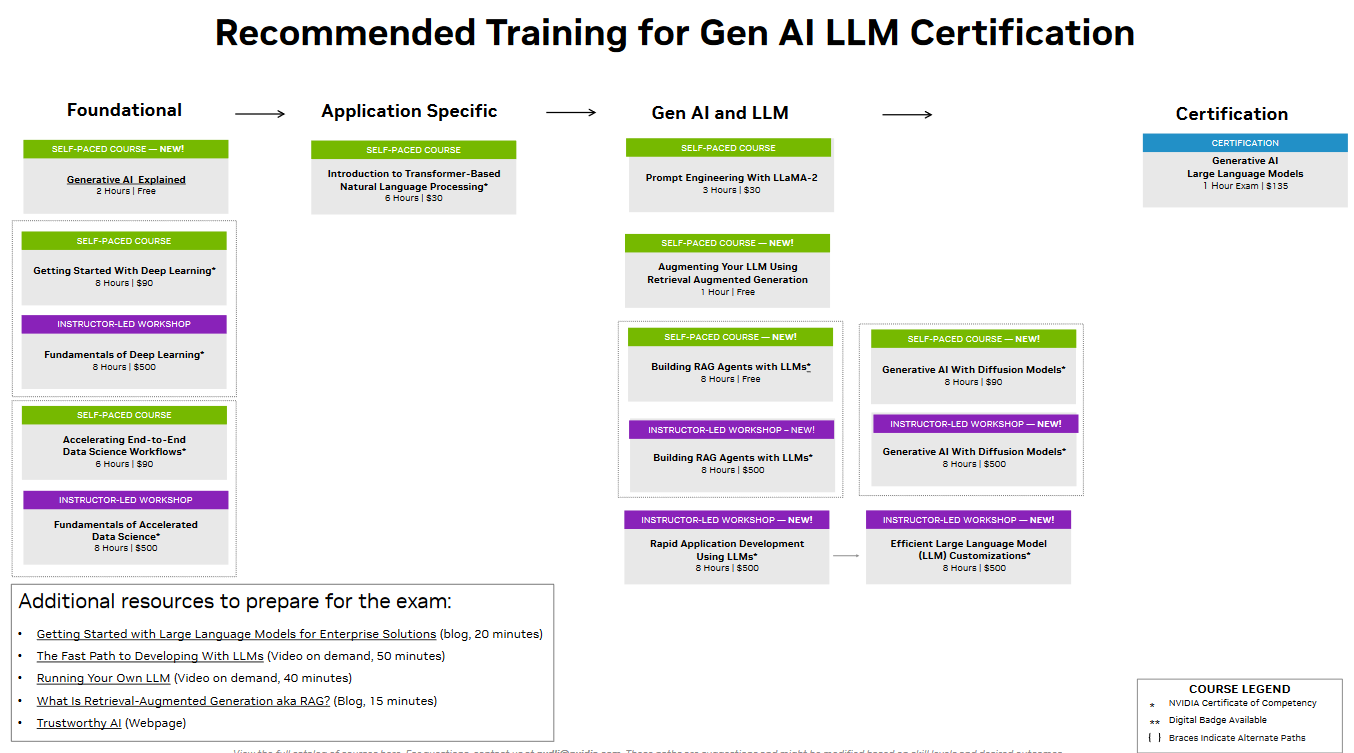

Consiste em:

- Um plano de aprendizado incluindo vários módulos agrupados em 3 temas : Fundamental, específico da aplicação, GenAI e LLM.

- Um exameEntregando a certificação

Como entendemos posteriormente, esses módulos não devem ser considerados de forma exaustiva, mas sim escolhidos a dedo, dependendo de suas habilidades e experiência em cada domínio. Nós nos concentramos nos módulos verdes (Indicipiado) e optou por dividir nossos caminhos de aprendizado da seguinte forma:

No final, o exame consiste em um MCQ de 50 perguntas a ser concluído em uma hora. Na seção a seguir, daremos uma visão geral de cada módulo que analisamos.

O que aprendemos

1. GenAI explicou

Este módulo fundamental fornece uma visão geral global do que a palavra popular “GenAI” abrange. O objetivo é definir os conceitos básicos do GenAI para iniciantes, bem como dar exemplos de aplicações da vida real — linguagem, imagens e assim por diante. Mas também introduz conceitos mais elaborados: como pretendemos capturar a distribuição de dados para gerar amostras com base em condições; estratégias para ajustar modelos de geração com base no feedback humano, composição entre texto e imagens... Finalmente, um resumo dos desafios e oportunidades do GenAI oferece a oportunidade de dar um passo atrás e listar todas as considerações que precisam ser levadas em consideração ao desenvolver ainda mais um aplicativo GenAI.

Feedback sobre o curso

- Prós: É realmente um bom aperitivo para compreender todos os aspectos do GenAI, não apenas as oportunidades, mas também os muitos desafios que surgem. O professor do curso é muito educativo.

- Contras: Você não vai aprender muito com este módulo, pois na verdade é uma introdução e não entra em detalhes. O questionário que ritma o módulo está mal estruturado (por exemplo, em caso de resposta errada, não se pode ver o motivo)

Portanto, este módulo é uma introdução muito útil para iniciantes e pode ser facilmente ignorado para pessoas que já têm noções sobre GenAI.

2. Começando com o aprendizado profundo

Aqui, começamos a entrar em detalhes. Este curso de 90 dólares e 8 horas é uma ótima oportunidade de descobrir o Deep Learning “da maneira mais difícil”, ou seja, programando de mãos dadas. Mas também é uma ótima atualização para pessoas que já estão familiarizadas com o aprendizado profundo, porque é muito completo e abrange os principais domínios do aprendizado profundo:

- O “olá, mundo” do Deep Learning: MISTA

- A teoria por trás Redes neurais : gradientes, retropropagação, otimizadores, e assim por diante

- Convoluções conceitos principais — pooling, desistência, norma de lote...

- Aumento de dados técnicas e considerações de implantação (quando os dados da vida real são diferentes dos dados de treinamento)

- Modelos pré-treinados e ajuste fino

- PNL e transformadores

Para cada tópico, uma aula de 5 a 10 minutos precedida por PyTorch implementação com cadernos pré-preenchidos.

Feedback sobre o curso

- Prós: Tendo experiência anterior com Deep Learning, ainda o achei útil como lembrete e muito bem estruturado, desde assuntos simples até assuntos mais complexos. Também aprendi algumas técnicas que eu não conhecia. Os notebooks são muito bem explicados, com explicações entre células de código. Por fim, as instâncias da NVIDIA possibilitam o treinamento fácil de modelos grandes.

- Contras: Os cadernos são exaustivos e poderiam ser um pouco menos orientados para incentivar os alunos a compreenderem os conceitos sozinhos. O tamanho do código não incentiva você a revisar e entender cada linha. Assim, é tentador executar rapidamente todas as células, o que, após várias aulas, resulta em menos memorização dos conceitos. Além disso, o conteúdo do curso poderia ser mais longo e claro.

Resumindo, este módulo é uma introdução bastante geral e detalhada ao aprendizado profundo, e seu principal interesse, na minha opinião, está na estrutura global do curso e no conteúdo dos notebooks com tecnologia Nvidia. No entanto, você pode facilmente encontrar recursos teóricos gratuitos sobre esse assunto.

3. Acelerando fluxos de trabalho de ciência de dados de ponta a ponta

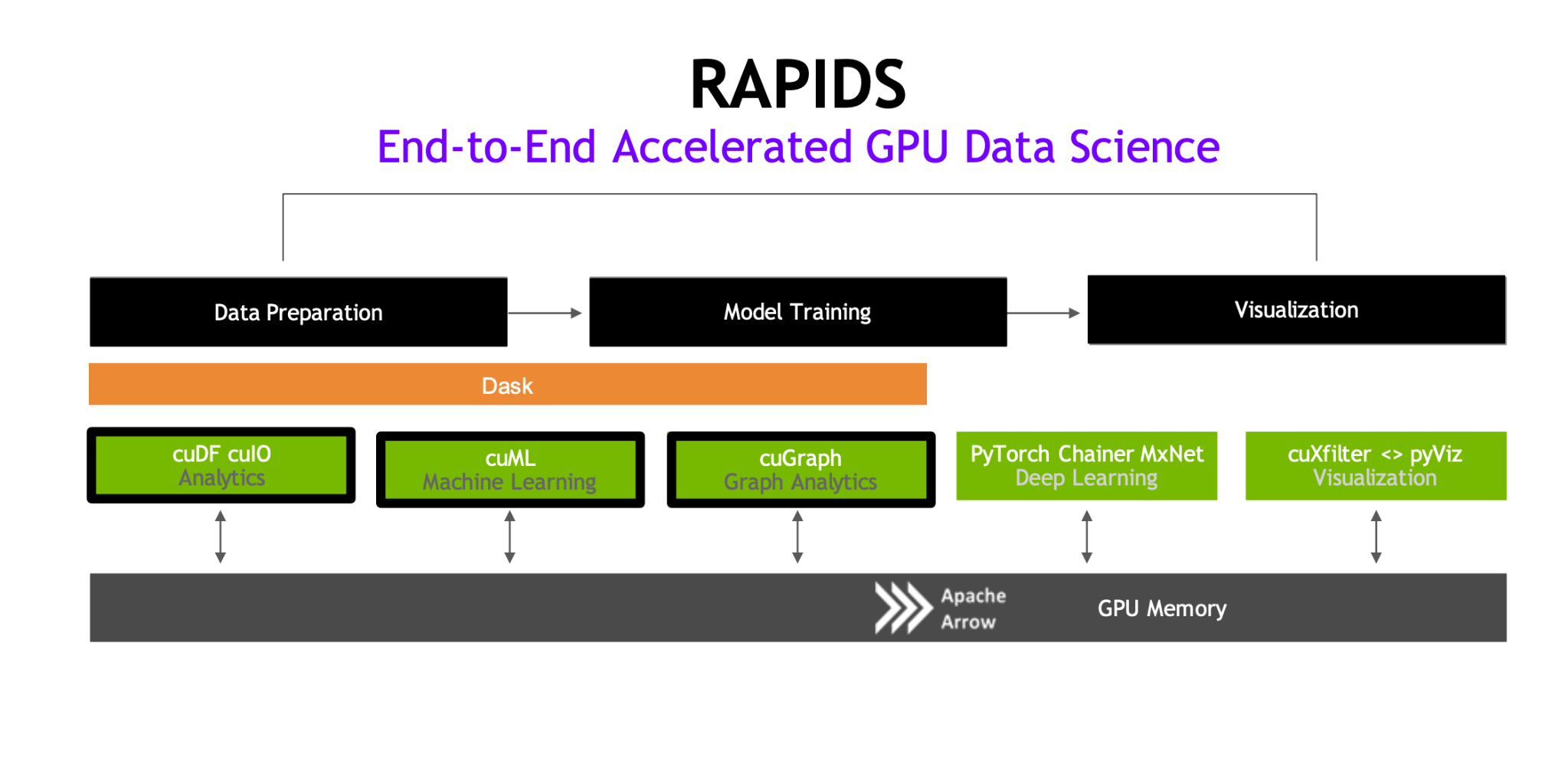

Este módulo apresenta a NVIDIA CORREDEIRAS, um pacote de software projetado para revolucionar os fluxos de trabalho de ciência de dados usando Aceleração da GPU, com desempenho até 10 vezes mais rápido do que os métodos convencionais de CPU.

RAPIDS — Ciência de dados de GPU acelerada de ponta a ponta

Um dos recursos atraentes do RAPIDS é sua compatibilidade com bibliotecas Python conhecidas. O RAPIDS fornece um equivalente acelerado por GPU para pacotes populares, permitindo que cientistas de dados migrem seus fluxos de trabalho com ajustes mínimos na sintaxe. Aqui está um resumo de alguns mapeamentos:

- Pandas vs. CuDF (RÁPIDO): Ambos fornecem DataFrames para manipulação de dados, mas o CuDF acelera as operações usando GPUs NVIDIA.

- Scikit-learn vs. CumL (RAPIDS): O Scikit-learn fornece algoritmos de aprendizado de máquina na CPU, enquanto o CuML acelera esses algoritmos nas GPUs.

- Bokeh vs. Filtro CUX (RAPIDS): O CuxFilter oferece exploração de dados interativa em tempo real em GPUs, tornando-o um substituto adequado para ferramentas de visualização tradicionais, como o Bokeh, para dados baseados em GPU.

A verdadeira força do RAPIDS está na aceleração e integração da GPU com Flecha Apache. Ao contrário das bibliotecas tradicionais de ciência de dados projetadas para processamento de CPU, o RAPIDS aproveita o poder de computação paralela das GPUs. Essa aceleração gera melhorias significativas no desempenho, geralmente 10 vezes mais rápidas do que soluções somente de CPU, como o Pandas.

Outra vantagem é o uso do Apache Arrow pelo QUICKS, um formato de memória que minimiza a movimentação de dados entre camadas de armazenamento, simplificando o pipeline de processamento de dados e reduzindo a latência. Com o Arrow, as operações de dados são mais eficientes, pois ele otimiza o armazenamento na memória e se alinha às necessidades da GPU, permitindo um processamento mais suave.

Prós:

- O treinamento foi conciso, com cursos de alguns minutos cada, permitindo uma abordagem focada sem informações desnecessárias.

- Os exercícios passo a passo foram particularmente eficazes, pois mostraram comparações de desempenho entre o RAPIDS e as bibliotecas tradicionais, com o RAPIDS provando ser cerca de 10 vezes mais rápido do que o Pandas na maioria dos casos.

- Um benefício importante foi a diferença mínima de sintaxe entre bibliotecas clássicas e Rapids — a transição foi simples, o que reduz a curva de aprendizado para novos usuários.

Contras:

- Uma desvantagem que observei foi que a documentação do RAPIDS parece um pouco limitada, o que pode tornar a solução de problemas um desafio.

4. Introdução à PNL baseada em transformadores

Este curso fornece uma introdução ao Modelos de grandes linguagens (LLMs) baseados em transformadores e suas aplicações em tarefas de PNL, como classificação de texto, reconhecimento de entidades nomeadas (NER), atribuição de autor e resposta a perguntas.

Os participantes aprendem como usar LLMs pré-treinados para aplicações como Chatbots e assistentes virtuais.

O curso se concentra fortemente na configuração, usando ferramentas como OmegaConf, PyTorch Lightning, e Nemo da NVidia. Em vez de codificar modelos do zero, os alunos ajustam os arquivos de configuração para configurar caminhos de dados, parâmetros do modelo e especificações de hardware para aceleração de GPU. Essa abordagem modular simplifica a implantação e mantém os fluxos de trabalho organizados, mas pode parecer menos prática, especialmente para quem está começando a usar configurações pesadas.

Prós:

- O curso oferece exemplos de notebooks pré-configurados que são fáceis de implementar, além de uma visão geral útil do PyTorch Lightning Trainer, abordando ações essenciais como ajuste, avaliação e previsão.

Contras:

- O conteúdo do curso é mínimo, com palestras muito breves e poucos exercícios práticos, limitando a profundidade teórica e técnica.

- As tarefas excessivamente simplificadas e as configurações pré-processadas tornam difícil apreciar as complexidades da PNL no mundo real.

5. Construindo agentes RAG com LLMs

Provavelmente o módulo do qual mais esperávamos, já que ambos estávamos familiarizados com os principais conceitos de LLMs, mas nenhum de nós havia manipulado nem implementado RAGs, o que constitui uma técnica muito útil quando se trata de traduzir o poder dos LLMs em aplicativos de negócios reais. O módulo era realmente muito rico (e demorado: nós dois gastamos muito mais do que as 8 horas indicadas, provavelmente cerca de 15). Ele abrange os seguintes tópicos:

- Visão geral dos serviços LLM, incluindo os da NVidia

- Langchain princípios principais (executáveis, prompts, analisadores)

- Administrando cadeias estaduais

- Documentos eEstratégias de fragmentação

- Incorporações e consultas

- Lojas de vetores (de estratégias ingênuas “sempre ativas” a estratégias mais complexas com lógica de ramificação)

- Avaliação (LLM como juiz, RAGAS)

Feedback sobre o curso

- Prós: Os cadernos do curso são muito técnicos e permitem compreender alguns conceitos-chave dos RAGs. Considerações de implementação na vida real são abordadas (incluindo avaliação)

- Contras: O conteúdo teórico (vídeo+slides) ainda é bastante esparso, alguns conceitos essenciais não recebem o tempo que merecem e parece que a estrutura do curso não é fácil de seguir. A avaliação final do notebook não é nada trivial e exige que você se aprofunde no código python (incluindo a compreensão de como os serviços interagem uns com os outros), e a depuração não é fácil. Essa complexidade poderia ser claramente evitada, pois não agrega valor ao curso RAG.

6. GenAI com modelos de difusão

Este curso apresenta aos alunos as aplicações de IA generativa em todos os setores, com um foco específico em Difusão de redução de ruído Modelos para geração de texto para imagem. Os participantes ganham experiência prática na construção e otimização de arquiteturas U-Net, aplicando processos de difusão para melhorar a qualidade da imagem e usando Linguagem contrastiva — pré-treinamento de imagens (CLIP) para geração de imagens baseadas em texto.

Feedback sobre o curso

- Prós: Os cadernos do curso são bem estruturados, apresentando as principais funções e parâmetros do PyTorch relevantes aos modelos de difusão, como adicionar dimensões temporais e incorporações de contexto. Ele oferece insights sobre conceitos avançados de otimização, como orientação de difusão sem classificador, e fornece uma exploração técnica mais profunda.

- Contras: O lento tempo de inicialização da VM da plataforma NVIDIA prejudica a experiência de aprendizado, assim como a baixa qualidade de áudio das leituras. O conteúdo do curso em si é limitado em profundidade, geralmente abrangendo conceitos básicos (por exemplo, U-Net, GANs, convoluções) sem desafiar os alunos a pensar criticamente. Embora os cadernos sejam detalhados, eles permitem uma rápida análise superficial ou um amplo mergulho profundo, com incentivo limitado para o aprendizado reflexivo.

Conteúdo do exame

A principal coisa a ter em mente ao se preparar para o exame é que ele não se concentra apenas nos módulos apresentados acima, mas avalia um conhecimento global do campo GenAI. É necessária uma sólida compreensão do GenAI, desde os principais conceitos de ML e DL até noções mais específicas de PNL, incluindo RAGs. Ele também aborda bibliotecas e recursos de computação específicos da Nvidia.

Tópicos adicionais que não fazem parte do plano de aprendizado incluem, por exemplo, testes A/B ou considerações éticas sobre IA.

Em termos de conteúdo, o exame consiste em 50 questões de múltipla escolha a serem concluídas em 1 hora:

- 45 perguntas Peça 1 resposta de 4 opções

- 5 perguntas Peça 2 respostas de 5 opções

Para dar uma ideia dos pesos de cada seção, eu tinha aproximadamente:

- 15 perguntas sobre geral Tópicos de ML/DL (funções de ativação, aprendizado de transferência, normalização de camadas, normalização de camadas, gradientes que desaparecem, redução de dimensionalidade, bibliotecas de ML,...)

- 15 perguntas sobre conceitos de PNL (motivação por trás dos transformadores, mecanismo de atenção, aprendizado rápido, engenharia imediata, análise de sentimentos, bibliotecas de PNL,...)

- 5 perguntas sobre RAGs (fragmentação, langchain, armazenamentos vetoriais, recuperação de documentos)

- 5 perguntas sobre a computação NVIDIA (servidor de inferência Triton, NeMO, TensorRT vs ONNX, otimize a taxa de transferência de CPU/GPU,...)

- 4 perguntas sobre Teste A/B (teoria versus prática)

- 3 perguntas sobre IA ética (especialmente na Iniciativa de Autenticidade de Conteúdo)

- 1 pergunta na transmissão

Que, somadas às que esqueci, devem somar 50 rostos piscando

Aprendizados da certificação NVIDIA GenAI LLMs e ideias adicionais

No geral, os módulos são bastante densos e definitivamente ajudam você a entender noções específicas do GenAI, ainda mais do que você é um iniciante na área. Aqui estão algumas ideias adicionais que, esperançosamente, ajudarão você a decidir se quer se aprofundar nessa certificação:

- Com este curso, você aprenderá muito sobre o GenAI, mas não será suficiente para concluir a certificação.De fato, uma compreensão global da área é muito benéfica para passar no exame. Por exemplo, nenhum módulo aborda testes A/B ou IA ética necessários para o exame. Além disso, alguns tópicos importantes do GenAI ainda não fazem parte do plano de aprendizado nem do exame, como o LLM-Ops.

- O plano de aprendizado inclui ótimos módulos, mas às vezes carece de um fio condutor.Ele foi construído organicamente, os módulos foram adicionados ao Deep Learning Institute da NVidia, um de cada vez, e a certificação só veio depois do agrupamento de alguns deles. Como resultado, às vezes não é fácil ver vínculos claros entre os módulos e, às vezes, os iniciantes podem se sentir bastante perdidos: quais noções são essenciais? Quais são boas de se ter?

- A qualidade do conteúdo dos módulos é variável.Alguns deles realmente mereceram nossa consideração (elogios por “Construindo agentes RAG com LLMs” e “GenAI com modelos de difusão”), enquanto outros pareciam um pouco mais vazios em nossa opinião (“Explicação do GenAI” ou “Introdução à PNL baseada em transformadores”). Alguns são muito teóricos (difusão), enquanto outros são superespecíficos (RAGs). Além disso, uma consistência extra entre os módulos — alto-falantes, qualidade de gravação (surpreendentemente), tempo gasto em notebooks — seria muito apreciada.

Esperamos que este artigo tenha sido esclarecedor. Não hesite em entrar em contato conosco se tiver alguma dúvida ou comentário e ficaremos felizes em ajudar!